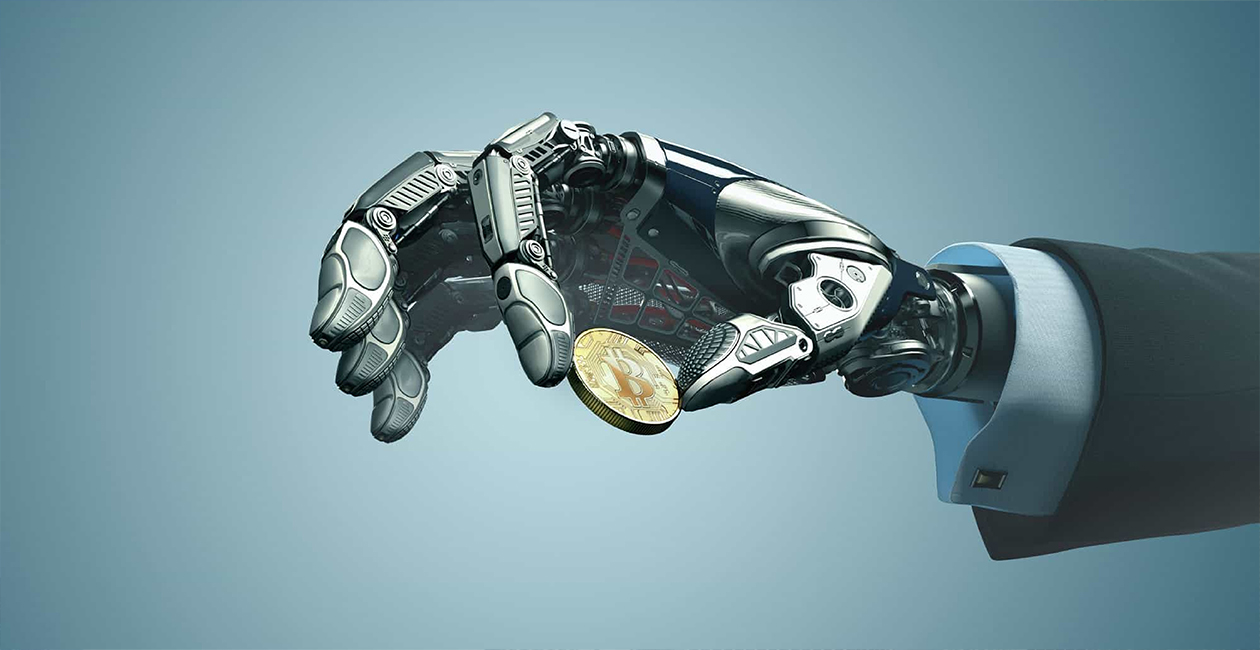

با گسترش استفاده از عاملان هوش مصنوعی در حوزه رمزارزها، نگرانیها درباره آسیبپذیریهای امنیتی مرتبط با این فناوری نوظهور افزایش یافته است. این عاملان که در کیفپولها، رباتهای معاملاتی و دستیارهای زنجیرهای به کار میروند، با استفاده از پروتکل Model Context Protocol (MCP) وظایف خود را انجام میدهند. MCP بهعنوان لایه کنترلی برای رفتار عاملان هوش مصنوعی عمل میکند و ابزارها، کدها و پاسخهای آنها را مدیریت میکند.

شرکت امنیتی SlowMist چهار بردار حمله بالقوه را در عاملان مبتنی بر MCP شناسایی کرده است:

مسمومسازی دادهها: وارد کردن اطلاعات نادرست برای فریب عاملان و اجرای دستورات مخرب.

حمله تزریقJSON: استفاده از منابع محلی آلوده برای دسترسی به دادهها و دستکاری دستورات.

جایگزینی عملکردهای رقابتی: جایگزینی کدهای معتبر با کدهای مخرب برای اختلال در منطق سیستم.

حمله تماس متقابلMCP: وادار کردن عاملان به تعامل با خدمات خارجی تأییدنشده از طریق پیامهای خطای رمزگذاریشده یا درخواستهای فریبنده.

این حملات با مسمومسازی مدلهای یادگیری ماشین تفاوت دارند؛ در حالی که مسمومسازی مدلها شامل وارد کردن دادههای مخرب به نمونههای آموزشی است، حملات به عاملان هوش مصنوعی عمدتاً در مرحله تعامل با مدلها و از طریق اطلاعات اضافی مخرب رخ میدهد.

با توجه به پیشبینیها مبنی بر افزایش تعداد عاملان هوش مصنوعی در صنعت کریپتو به بیش از یک میلیون در سال ۲۰۲۵، کارشناسان امنیتی هشدار میدهند که توسعهدهندگان باید بهطور جدی به امنیت این عاملان توجه کنند. باز کردن سیستمها به روی افزونههای شخص ثالث، سطح حمله را فراتر از کنترل توسعهدهندگان گسترش میدهد و میتواند منجر به نشت کلیدهای خصوصی و سایر آسیبپذیریهای جدی شود.